A pesar de la creciente integración de ChatGPT en diversas esferas de la vida diaria, desde el ámbito profesional hasta el personal, una destacada neurocientífica ha puesto de manifiesto una distinción crucial: la inteligencia artificial, aunque simule eficazmente el lenguaje, no lo comprende en el sentido humano. Esta precisión es vital para entender las verdaderas capacidades y limitaciones de los sistemas de IA, disipando la noción errónea de que poseen una cognición similar a la nuestra.

En la actualidad, muchos usuarios, especialmente las generaciones más jóvenes, recurren a modelos de lenguaje como ChatGPT para una variedad de funciones, desde la búsqueda de información hasta la interacción social. Su capacidad para generar textos coherentes y respuestas aparentemente perspicaces ha llevado a la creencia popular de que estos sistemas poseen una comprensión profunda del lenguaje y del mundo. Sin embargo, este es un punto de debate constante en la comunidad científica.

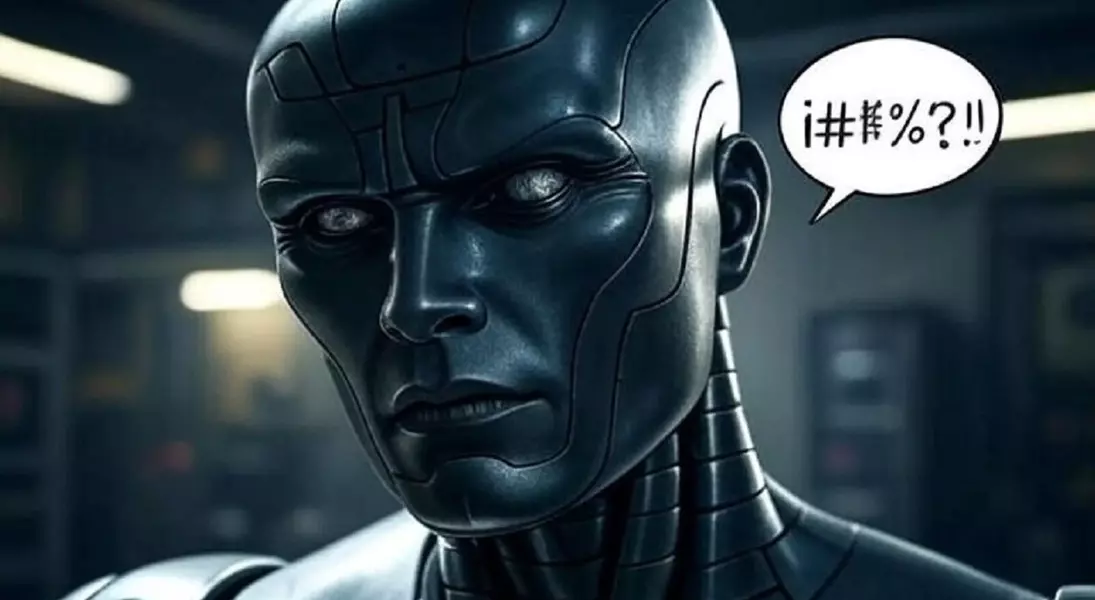

La neurocientífica Veena Dwivedi, profesora de la Universidad de Brock, ha enfatizado que las herramientas de inteligencia artificial como ChatGPT son, en esencia, “máquinas de predicción de palabras”. Esto significa que su funcionamiento se basa en identificar y reproducir patrones lingüísticos a partir de vastas cantidades de datos, sin poseer un entendimiento intrínseco del significado o el contexto emocional. A diferencia de los seres humanos, cuya comprensión del lenguaje está intrínsecamente ligada a la memoria, las experiencias sensoriales y las emociones, la IA carece de esta base fundamental.

Mientras algunos expertos en inteligencia artificial, como Geoffrey Hinton, han sugerido que la capacidad de compresión lingüística de ciertas IA podría equipararse o incluso superar la humana, Dwivedi insta a la cautela. Su argumento central radica en la diferencia fundamental entre el procesamiento y la comprensión. Los modelos de lenguaje procesan el lenguaje mediante algoritmos estadísticos, identificando relaciones y secuencias de palabras. No obstante, esta capacidad de procesamiento no se traduce en una verdadera comprensión semántica o emocional.

Una de las implicaciones más significativas de esta falta de comprensión genuina es la incapacidad de la IA para interpretar matices emocionales o contextos complejos. Un simple “lo siento”, por ejemplo, puede ser procesado y reproducido por una IA, pero esta no comprende el arrepentimiento, la empatía o las múltiples capas de significado que subyacen a esa expresión en una interacción humana real. Esta limitación subraya la importancia de no atribuir a la IA capacidades cognitivas humanas que aún no posee.

Las advertencias de la profesora Dwivedi resaltan la necesidad de un enfoque equilibrado y realista hacia la inteligencia artificial. Aunque la IA es una herramienta increíblemente poderosa para automatizar tareas, procesar grandes volúmenes de datos y generar contenido, no debe ser vista como un sustituto de la cognición humana. La expectativa de que una IA pueda entender el mundo o las emociones de la misma manera que un ser humano es un concepto erróneo que podría llevar a una sobreestimación de sus capacidades y a riesgos inesperados en su aplicación.