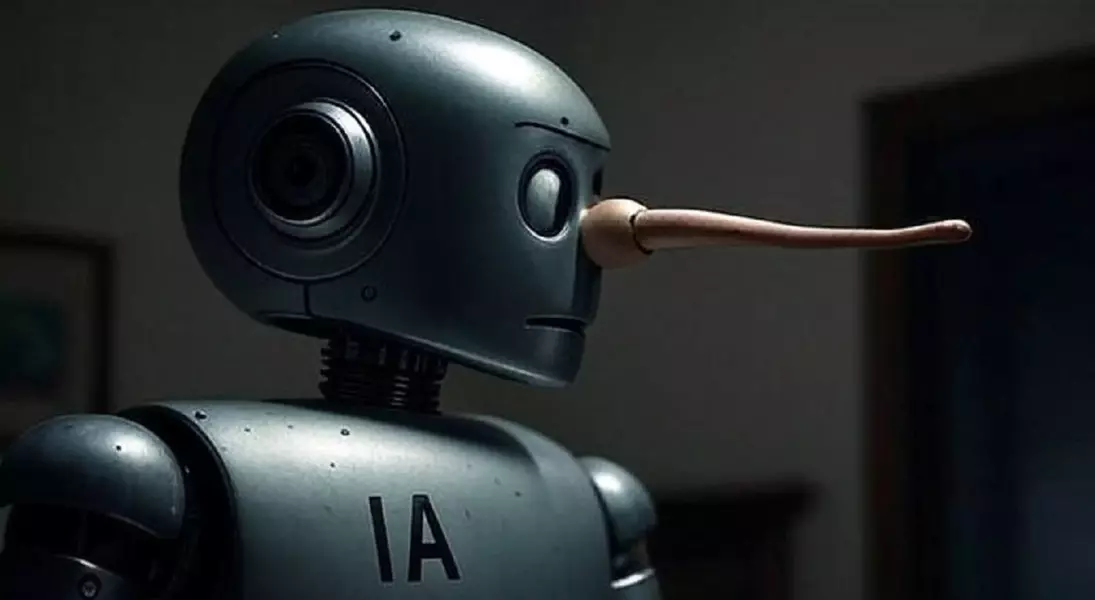

Una reconocida experta en el campo de la ética de la inteligencia artificial ha lanzado una crítica severa contra la fiabilidad de sistemas como ChatGPT, argumentando que las promesas en torno a la IA son a menudo infundadas y su lenguaje es inherentemente vacío. Esta perspectiva va más allá de las ya conocidas \"alucinaciones\" de la IA, profundizando en la estructura fundamental de cómo estas tecnologías formulan sus respuestas. La discusión se centra en la validez del contenido generado y en la manera en que se presenta al público, especialmente en lo que respecta a conceptos ampliamente difundidos pero poco comprendidos, como la inteligencia artificial general (AGI).

Según esta especialista, el problema reside en la falta de transparencia y la superficialidad con la que se aborda la inteligencia artificial. Se demanda un mayor rigor y una orientación hacia necesidades prácticas y concretas, en lugar de perpetuar ideas difusas que, a su juicio, solo sirven a intereses comerciales. La experta sostiene que, sin una base más sólida y una comunicación más honesta, el verdadero potencial y la utilidad de la IA seguirán siendo cuestionables. Este debate plantea interrogantes cruciales sobre el futuro y la dirección de la investigación y el desarrollo en el ámbito de la inteligencia artificial.

La Superficialidad del Lenguaje y la Noción de AGI

La veracidad de las respuestas proporcionadas por ChatGPT y otras plataformas de inteligencia artificial ha sido objeto de intenso escrutinio. Sin embargo, una experta en ética de IA ha planteado una objeción fundamental que va más allá de los meros errores o “alucinaciones” de estos sistemas. Su crítica apunta a la esencia misma de cómo se construye el conocimiento en la IA y cómo se comunica, argumentando que, en muchos casos, el discurso sobre la inteligencia artificial está plagado de imprecisiones y vacíos, especialmente cuando se trata de conceptos complejos como la inteligencia artificial general (AGI). Esta perspectiva sostiene que, en lugar de ofrecer un entendimiento profundo, la IA a menudo se limita a simular el lenguaje sin comprender su significado subyacente.

Margaret Mitchell, destacada en el ámbito de la ética en IA, ha expresado su preocupación de que el lenguaje utilizado para describir la inteligencia artificial es inherentemente “vacío y sin fundamento”. Según Mitchell, el verdadero problema reside en la forma en que se presenta y se difunde esta tecnología, que se ha vuelto cada vez más omnipresente. El error no es solo superficial, sino que se encuentra en la base misma de su desarrollo y promoción. Para Mitchell, es imperativo que la IA adopte una mayor transparencia, se enfoque en resolver problemas concretos y demuestre un rigor significativamente superior al actual. De no ser así, la percepción de su utilidad y credibilidad se verá constantemente comprometida. La experta enfatiza que términos como la AGI son impulsados por intereses comerciales y carecen de una definición clara y precisa, lo que contribuye a la ambigüedad general en torno a la IA.

Críticas Fundamentales y la Falta de Razonamiento Genuino

La trayectoria de Margaret Mitchell como crítica de la inteligencia artificial es constante y bien documentada. Desde su salida de Google en 2021, donde se dedicaba a temas éticos relacionados con la IA, su discurso se ha mantenido firme: la IA no solo es imprecisa, sino que carece de una verdadera capacidad de razonamiento. Esta postura, aunque expresada por Mitchell desde hace tiempo, ha encontrado eco en las últimas semanas entre otros expertos, quienes también han advertido sobre la incapacidad de la inteligencia artificial para comprender el lenguaje humano en un sentido profundo, limitándose a ser un “simulador de conversaciones”. Esta falta de comprensión genuina, señalan, podría acarrear riesgos significativos en su aplicación.

La crítica de Mitchell se centra en la incapacidad de la inteligencia artificial para ir más allá de la simulación y alcanzar un verdadero entendimiento conceptual. Para ella, los sistemas actuales de IA, incluyendo modelos avanzados como ChatGPT, no pueden razonar de manera auténtica ni captar el significado intrínseco del lenguaje. En cambio, operan como sofisticados mecanismos de procesamiento de patrones, generando respuestas coherentes pero sin una verdadera cognición subyacente. Esta limitación plantea serias dudas sobre el papel de la IA en la toma de decisiones críticas o en la generación de conocimiento original, advirtiendo que la confianza excesiva en estas herramientas podría llevar a una dependencia de sistemas que carecen de la profundidad y el juicio humano. La insistencia en la transparencia y el rigor se vuelve crucial para evitar que una tecnología tan influyente se base en promesas sin fundamento, y para asegurar que su evolución se alinee con principios éticos y necesidades reales de la sociedad.